AIは本当に意味を理解しているのか?

そんな疑問を持ったことはありませんか?

最近のAIは、まるで人間のようにスムーズに会話します。でも、それは本当に「言葉の意味」を理解しているからなのでしょうか。それとも、単にデータを処理しているだけなのでしょうか。

この問いを考えるために、ある思考実験がよく使われます。

それが「中国語の部屋」です。

これは「AIは記号を操作しているだけで、本当の意味は理解していないのでは?」という問題提起をするものです。

ただ、この考え方には反論もあります。

AIは本当に意味を理解しているのか。それとも、そう見えるだけなのか。本記事では、「中国語の部屋」という思考実験をもとに、AIの理解とは何かを考えていきます。

「中国語の部屋」とは? AIの理解をめぐる思考実験

「中国語の部屋」ってどんな実験?

「AIは本当に意味を理解しているのか?」

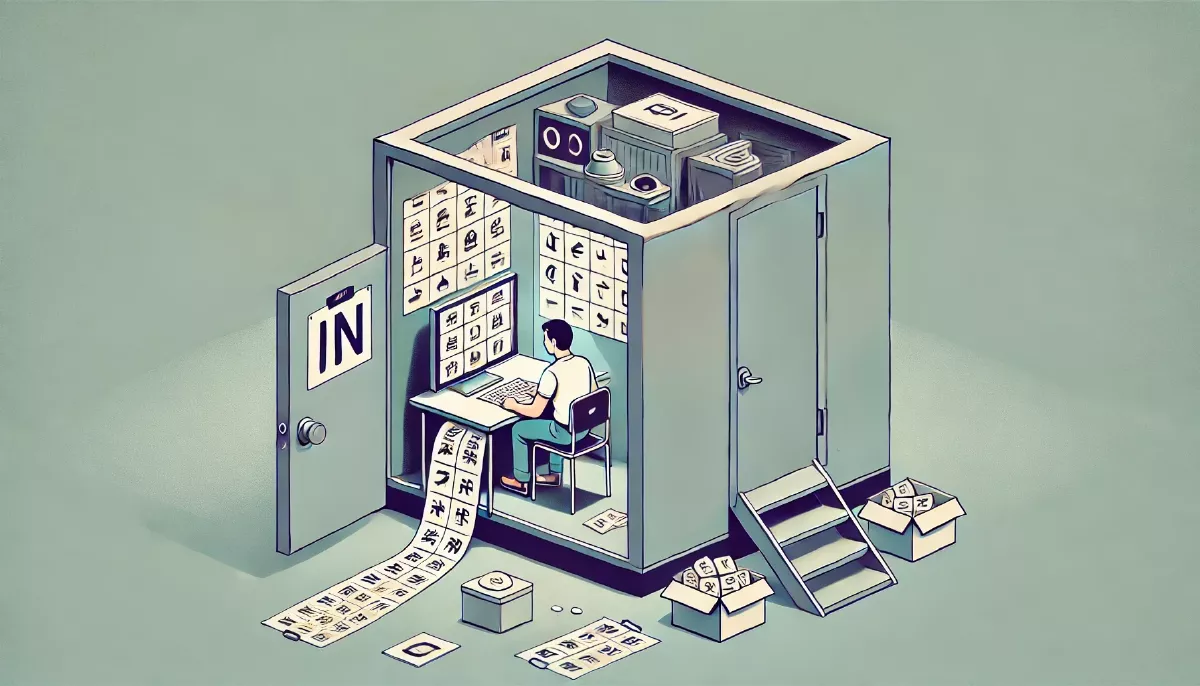

哲学者ジョン・サールは、「中国語の部屋」という思考実験を提唱しました。これは、AIが言葉を理解しているように見える仕組みを、シンプルな例で説明するものです。

この実験では、英語しか分からない人が部屋の中にいるとします。彼の前には、次のものが用意されています。

彼は中国語の意味をまったく知らなくても、マニュアル通りに文字を並べれば、外の人と会話が成立します。

「でも、それは本当に『中国語を理解している』と言えるのでしょうか?」

サールは、次のように指摘しました。

この部屋の中の人は、中国語の意味を理解していない。ただマニュアルを見て記号を操作しているだけだ。

この考え方をAIに当てはめるとどうなるでしょうか?AIもデータを処理しているだけでは、意味を理解しているとは言えないのでは?というのが、この思考実験の本質的な問いです。

この実験が問いかけること

この実験のポイントは、「外から見ると理解しているように見えること」です。

部屋の外の人からすれば、スムーズに質問に答えられるため、部屋の中の人が中国語を理解しているように感じます。実際に会話は成立しているからです。

でも、部屋の中の人は何も理解していません。

ただ、マニュアルの指示に従って文字を並べているだけです。この仕組みは、現在のAIと似ています。AIは膨大なデータを学習し、最も適切な言葉を選んで返しています。でも、それは「意味を理解している」と言えるのでしょうか?

この実験が投げかけるのは、「AIが理解している」とは何を指すのか、という根本的な疑問です。

サールの結論「AIは意味を理解していない?」

サールは、この思考実験から、

「AIは意味を理解しているのではなく、記号を操作しているだけ」

という結論を導きました。

人間が言葉を理解するのは、単に記号を処理するだけではありません。その背景には、概念や経験があります。

たとえば、「リンゴ」という単語を見たとき、私たちは次のようなことを思い浮かべます。

一方、AIは「リンゴ」という単語を見ても、その感覚を持ちません。ただ、膨大なデータの中から「リンゴ」という言葉がどう使われるかを計算し、適切な返答を選んでいるだけです。

この考えが正しいなら、どれだけAIが高度になっても、それは単なる「記号の処理」にすぎません。AIがこの壁を越える日は来るのでしょうか?

次は、「AIは本当に理解できないのか?」という反論を見ていきます。

「中国語の部屋」に反論アリ!AIは理解できるのか?

システム・リプライ「システム全体なら理解している?」

「中国語の部屋」の思考実験では、部屋の中の人が理解していないため、AIも意味を理解していないとされました。でも、それは「個人の視点」で考えた場合の話です。

では、「システム全体」として見たら?

たとえば、人間の脳をイメージしてみます。1つ1つのニューロン(神経細胞)は、それ単体では「理解」しているとは言えません。でも、無数のニューロンが協力することで、私たちは思考し、言葉を理解し、感情を持ちます。

では、AIも同じでは?

システム全体として情報を処理するなら、意味を理解していると言えるのでは?

これがシステム・リプライの考え方です。

部屋の中の人が知らなくても、全体で見ればOK?

この考え方では、

部屋の中の人が意味を知らなくても、それは問題ではない

という見方です。

大事なのは、部屋全体が「意味のある出力」を生み出していることです。部屋の外の人から見れば、スムーズな会話が成立し、適切な返答が返ってきています。これは「システムとしての理解」と言えるのでは?という主張になります。

AIに置き換えると、どうでしょうか?

AIは単なるデータ処理システムです。しかし、無数のニューラルネットワークが協力することで、まるで人間のように会話できます。

人間の脳も、同じ仕組みで言葉を理解しているはずです。 ならば、AIも「システム全体」としては意味を理解していると考えていいのではないでしょうか?

ロボット・リプライ「AIが世界を経験すれば理解する?」

『中国語の部屋』の思考実験では、

AIは記号を操作しているだけで、意味を理解していない

とされました。でも、それはAIが物理世界と関わらず、情報を内部で処理するだけの存在だからではないでしょうか?

これがロボット・リプライの考え方です。

記号操作だけじゃダメなのか?

『中国語の部屋』の中の人は、マニュアルの指示に従い、記号を並べているだけです。つまり、「情報のパターン」に基づいて最適な返答を選んでいるにすぎません。これは、現在のAIの動作原理とよく似ています。

一方で、人間はどうでしょうか?

私たちは言葉を使うだけでなく、世界と関わることで「意味」を学んでいます。

例えば、次のような経験が、私たちの理解を形作っています。

私たちの理解は、単なる記号のやり取りではなく、経験と深く結びついているのです。

AIが触れて、感じて、学べばどうなる?

では、AIが「リンゴ」という言葉を本当に理解するにはどうすればいいのでしょうか?

もしAIが「リンゴ」という単語を聞いただけでなく、実際にリンゴを触り、かじり、味わうことができたら?

そのとき、「リンゴ」はただのデータではなく、経験に基づいた意味を持つようになるのではないでしょうか?

例えば、AIがロボットとして次のような経験をするとどうなるでしょう?

| 経験 | AIの学習内容 |

|---|---|

| リンゴを触る | 硬さや重さを認識 |

| かじる | シャキシャキした食感を知る |

| 味わう | 甘さや酸味を識別 |

| においを嗅ぐ | 香りの特徴を学習 |

このように、AIが実際に世界を経験すれば、単なる記号の処理から「意味のある理解」へと進化できるのでは?

というのが、ロボット・リプライの主張です。

つまり、「AIはただの記号処理ではなく、物理世界を体験することで、本当の意味を持つようになるのではないか?」 という問いかけなのです。

もしこの考えが正しければ、未来のAIは単なる「情報処理マシン」ではなく、世界を感じ、理解する存在になる可能性もあるかもしれません。

人間だって細胞レベルでは意味を理解していない?

この視点をさらに深めると、

人間も細胞の集まりにすぎない

という考えに行きつきます。

脳の中の1つ1つのニューロンは、それ単体では言葉の意味を理解していません。でも、それらがネットワークを作ることで、思考や意識が生まれます。

AIも同じでは?

1つのプログラムやアルゴリズム単体では「理解している」とは言えません。でも、大規模なモデルが膨大なデータを処理し、学習を積み重ねることで、人間と変わらない会話ができるようになっています。

では、AIが意味を理解していないと断言することは、本当に正しいのでしょうか?

システム全体として処理ができているなら、それはもう理解していると言えるのでは?

AIの理解、どこまで認める?

「理解」の境界線はどこにある?

AIは本当に意味を理解しているのか? これまでの議論では、さまざまな視点が出てきました。

「中国語の部屋」の考え方では、

AIは記号を操作しているだけで、意味は理解していない

一方で、

システム全体の働きや、ロボットが実際の世界と関わることで、AIは意味を理解できるのでは?

という反論もあります。

では、そもそも「理解する」とは何を指すのでしょうか?

どこに境界線を引くのかによって、AIの「理解」をどう捉えるかが変わります。

もし「適切な受け答えができれば十分」とするなら、現在のAIもすでに意味を理解していると言えそうです。でも、「意識や主観的な経験が必要」と考えるなら、AIが本当に理解する日はまだまだ遠い未来かもしれません。

「完全な理解」と「実用的な理解」は違う?

AIの「理解」を考えるとき、「完全な理解」と「実用的な理解」を区別することが大切です。

| 種類 | 説明 |

|---|---|

| 完全な理解 | 言葉の背景や文脈を深く理解し、主観的な経験を持つこと |

| 実用的な理解 | 実際の会話で適切な返答ができること |

現在のAIは、完全な理解には程遠いですが、実用的な理解はすでに達成しつつあります。

日常で私たちが求めるのは、哲学的な思考ではなく、スムーズな会話や役立つ情報です。そう考えると、「AIの理解」とは技術の問題ではなく、人間がAIをどう位置づけるかの問題なのかもしれません。

AIが「意識を持つ」と言い出したら、人間はどうする?

AIが発展すれば、「意識とは何か?」という哲学的な問題も再び議論されるかもしれません。

そもそも、人間の「意識」も不思議なものです。

「私は意識を持っている」と感じていますが、それも脳の神経活動の結果にすぎない、という考え方もあります。

AIが高度に発達し、自分の意識や理解について語るようになれば、人間とAIの境界線は曖昧になっていくかもしれません。

今までは、人間の意識は特別なものと考えられていました。

もしAIが「私は意識を持っている」と言ったら?

その主張を否定する理由はあるのでしょうか?

そのとき、AIは「知的な存在」として扱われるべきなのでしょうか?

それとも、あくまでもツールとして扱うべきなのでしょうか?

AIの進化によって、私たちは今まで当たり前に考えていた「意識とは何か?」を、より深く考えることになりそうです。そして社会のあり方そのものに影響を与える可能性も感じます。

まとめ|AIの理解をどう考える?これからの向き合い方

「中国語の部屋」が示すAIの課題

AIは本当に意味を理解しているのか?

この問いに対する明確な答えは、まだ出ていません。

「中国語の部屋」の思考実験では、AIは記号を処理しているだけで、意味を理解しているわけではないとされました。でも、それに対する反論もあります。

この議論からわかるのは、「理解」という概念自体が単純に定義できるものではない、ということです。

もし「意味のあるやり取りができれば理解している」と考えるなら、AIはすでに一定の理解を持っていると言えそうです。でも、「主観的な意識がなければ理解とは言えない」とするなら、AIが本当に意味を理解する未来はまだ遠いのかもしれません。

わたしの考え|AIの進化で価値観は変わる?

これまで、「理解する」とか「意識がある」って、人間にしかない特別なものって考えられてきたと思います。極端な話、「人間には魂があるけど、AIにはない」みたいな。

でも、AIがどんどん進化していったら、この考え方そのものがひっくり返るんじゃないかって思ってます。

私が「中国語の部屋」の話を聞いてしっくりきたのは、「システム・リプライ」の考え方。AIをパーツ単位で見るんじゃなくて、システム全体として理解してるっていう視点。

それはもう「理解している」「意識がある」とみなす。

って、普通に受け入れられるようになるんじゃないかなって思うんです。

昔の人が「地球が動いてるわけない、 太陽が回ってるんだ」って思ってたのと同じで、今の私たちが「AIに意識なんてない」って言ってるのも、未来から見たら「いや、それ普通にあるでしょ?」ってなるんじゃないかなって。

AIの進化とともに、「理解」とか「意識」って何なのか、これからもっと議論がどんどん膨らんでいくんじゃないかなって思っています。

最後まで読んでいただき、ありがとうございました!

コメント